摘要: 比特币诞生十七年来,区块链行业经历了爆炸式的扩张:数以千计的公链、数以万计的代币、PoW与PoS的路线之争、L1与L2的架构分歧、DeFi的繁荣与崩塌、无数跨链桥的建设与被黑……用户在转账时需要在几十条链和协议之间做选择,稍有不慎就会丢失资产。这个行业看起来越来越复杂,却似乎离中本聪白皮书中描述的”点对点电子现金系统”越来越远。

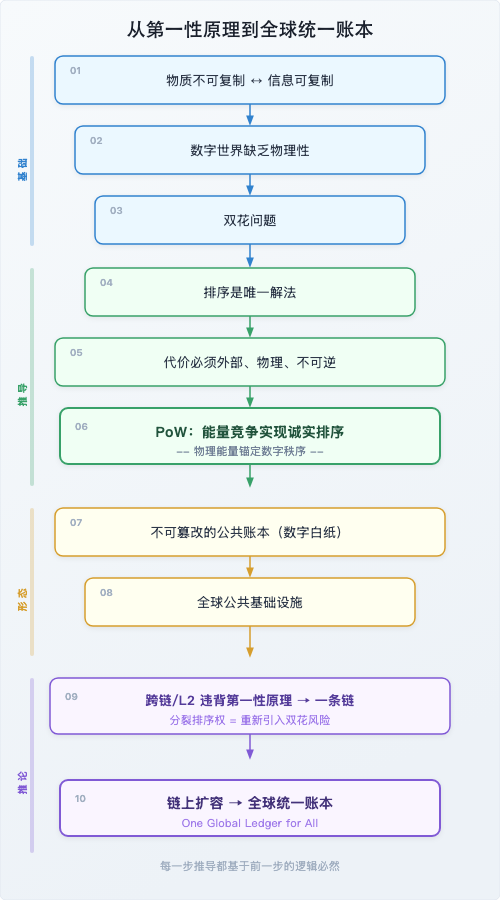

纷繁复杂的表象之下,是否存在一些不可被违背的基本原则?如果回到最底层的物理定律和经济规律,区块链的技术路线是否有一个确定的方向?本文尝试从第一性原理出发,以物质与信息的根本差异为唯一起点,逐步推导出一条完整的逻辑链——从双花问题到工作量证明的必然性,从数字世界的”白纸”到全球统一账本的终局。推演的每一步都力求是前一步的逻辑必然,而非立场选择。结论或许会挑战许多行业共识,但推导过程是开放的、可检验的。

把一张百元钞票递给你,我手里就没有了。这是物理世界最平凡的事实,平凡到我们几乎不会注意它。但正是这个事实,支撑了人类数千年的经济活动——从贝壳交易到黄金结算,一切价值转移的底层逻辑都建立在同一个前提上:物质不可复制。

信息不是这样的。

把一份文件发给你,我手里还有一份。这不是数字技术的缺陷,不是某种可以被修复的 bug——这是信息的本质属性。信息是可以被精确编码的抽象模式,而抽象模式与物理载体天然可分离——同一段比特序列可以被无损地复制到任意数量的硬盘、光纤、无线电波上。

物质和信息的这个根本差异,是本文全部推理的起点。

数字世界缺失的三样东西

物质不可复制这个简单事实,在物理世界中自然地衍生出三个基本属性。

稀缺性。 地球上的黄金总量有限,不是因为某个权威机构在控制供给,而是因为原子不可凭空创造。物理世界的资源天然稀缺,这种稀缺不需要任何人去”维护”,它是物理定律的直接结果。

排他性。 你握着一块石头,别人就握不了同一块石头。物理物品在任一时刻只能被一个人持有——所有权本质上是对物理排他性的社会确认。

不可篡改性。 在纸上写下一行字,你可以划掉它,但划掉的痕迹本身无法消除。物理世界中的每一次修改都会留下痕迹,因为改变物质状态需要做功,而做功必然产生不可逆的熵增。

数字世界不具备上述任何一条。数字信息可以无限复制,所以没有稀缺性。同一份数据可以同时存在于一万台机器上,所以没有排他性。修改一个比特不会留下任何物理痕迹,所以没有不可篡改性。这不是数字技术不够成熟。这就是比特的本性。

双花:一个必然出现的问题

理解了上述差异,“双花问题”就不再需要解释——它是一个不可避免的逻辑推论。

假设你要在纯数字环境中创造一种”货币”。这种货币本质上是一串比特。而比特可以被精确复制。那么,持有者完全可以把同一笔钱复制一份,分别发给两个人。这就是双花问题(double-spending problem)。它不是某个特定系统设计中的漏洞,而是信息可复制性在货币场景下的直接表现。

传统数字支付系统的应对方式很直接:引入一个可信第三方。银行维护一个中心化的账本,每笔交易都由银行确认和记录。这个方案有效,但代价是:整个系统的安全性和可用性完全取决于这个第三方。银行可以拒绝你的交易,可以冻结你的账户,可以审查你的每一笔支出。

换言之,传统方案没有真正解决双花问题——它只是把问题转化了:从”如何防止数字货币被复制”变成了”如何信任这个中心化的记账者”。

真正的问题于是变成:能否在不依赖任何可信第三方的前提下,在纯数字环境中解决双花问题?

比特币之前的探索

这个问题并非始于2008年。在中本聪之前,一代密码学家和计算机科学家已为此奋斗了二十余年。

1983年,David Chaum 发表了盲签名(blind signature)论文,提出了匿名数字支付的密码学基础。1989年,他创立了 DigiCash——第一个实用的匿名数字支付系统。DigiCash 在技术上是优雅的,但它依赖银行作为可信第三方来验证交易、防止双花。当唯一合作的银行退出后,DigiCash 于1998年破产。中心化的单点依赖,既是它的运行前提,也是它的致命弱点。

1997年,Adam Back 提出了 Hashcash——用计算难题来对抗垃圾邮件。这是工作量证明(Proof of Work)概念的先驱,后来直接启发了比特币的挖矿机制。1998年,Wei Dai 发表了 b-money 提案,首次系统性地描述了去中心化数字货币的设想,但没有给出可行的共识机制。同年,Nick Szabo 提出了 Bit Gold 方案——在所有前比特币设计中最接近最终答案的一个,它结合了工作量证明和时间戳链,但始终未能解决去中心化环境下的共识收敛问题,最终停留在构想阶段。2004年,Hal Finney 基于 Hashcash 构建了 RPOW(Reusable Proof of Work)——一种可重复使用的工作量证明系统,但验证仍依赖一台可信服务器。

这些先驱项目勾勒出同一条问题主线:如何在没有可信第三方的条件下防止数字货币被双花?它们要么依赖中心化机构来执行规则,要么无法在去中心化环境下达成共识。核心的转变方向已经清晰——从相信中心化机构不会作恶(won’t be evil),到使其在结构上不能作恶(can’t be evil)——但实现这个转变的工程方案,直到2008年才出现。

2008年,中本聪给出了他的回答。

排序:解决双花的唯一方式

暂时忘掉中本聪,忘掉区块链,回到双花问题本身。

同一笔钱被花了两次——一次给了 Alice,一次给了 Bob。这两笔交易在数据层面都是合法的,签名正确,余额充足。如何判定哪笔有效?

唯一的判据是时间顺序。如果能确定给 Alice 的交易发生在先,那它有效,给 Bob 的那笔就是双花,应被拒绝。具体谁先谁后不重要,重要的是存在一个确定的、所有人公认的先后顺序。一旦全局排序确立,双花在逻辑上就不可能存在。

这不是一种可选的技术方案。这是唯一的机制。银行的全部权力,归根结底,就是对交易排序的垄断权。

中本聪在白皮书中将他的方案描述为”distributed timestamp server”——分布式时间戳服务器。比特币要解决的不是加密问题,不是数据库问题,而是排序问题。

问题于是变得尖锐:排序需要一个排序者。但”不依赖可信第三方”意味着不能有一个被信任的排序者。那么,谁来排序?

去中心化:一个工程决策,不是政治立场

“去中心化”在过去十几年的传播中被附加了太多意识形态色彩。这些叙事或许有其文化价值,但它们遮蔽了一个简单的技术事实。

去中心化是一个工程手段。它的目的不是颠覆什么,而是消除对可信第三方的依赖。

在物理世界中,我把一枚硬币放到你手里,交易就完成了。不需要银行批准,不需要第三方见证。物理定律本身保证了这枚硬币不会被我复制。这个过程是天然去中心化的——不是因为我们在做政治抗议,而是因为原子层面的交易根本不需要中介。

当我们说比特币是去中心化的,准确含义是:它的排序机制不依赖任何单一实体的诚实或能力。不是因为中心化”邪恶”,而是因为任何中心节点都是单点故障。去中心化是对这个工程风险的系统性回答。

为什么作弊的代价必须是外部的、物理的、不可逆的

现在我们面对一个精确的工程问题:一组互不信任的参与者,需要就交易顺序达成一致,且不依赖任何可信第三方。

在这种设定下,排序的诚实靠什么保证?靠不了道德——开放网络允许匿名加入。靠不了法律——无身份、跨司法管辖区。靠不了投票——女巫攻击(即攻击者在匿名网络中以零成本伪造大量身份来操纵投票或共识的攻击方式)使”一人一票”在匿名网络中失效。

剩下唯一的路径是:让作弊有代价,让诚实有回报。 如果篡改排序的预期损失始终大于预期收益,理性的参与者就会选择诚实。不需要假设任何人是好人,只需要假设他们会算账。

但”代价”本身需要满足极其严格的条件。

第一,代价必须是系统外部的。

假设参与者需要质押系统内部发行的代币,作弊时没收质押物。谁来判定”作弊”?系统中的其他参与者。谁来执行”没收”?还是这批参与者。现在设想:超过一定比例的参与者决定串通。他们可以集体篡改排序,投票判定篡改是”合法”的;可以修改惩罚规则,免除自己的罚款;甚至可以分叉出一条新链,恢复被没收的质押物。这是球员兼裁判的困境——用一个依赖于诚实多数的机制来保证诚实多数,是循环论证,不是安全保障。

外部代价不存在这个问题。矿工消耗的电力付给了电网,购买的硬件付给了制造商——这些支出发生在比特币系统之外,无论链上发生什么,花掉的钱不会回来。系统外部的代价不受系统内部规则的管辖,无法被任何多数派操纵或取消。

第二,代价必须是物理的、不可逆的。

能量消耗完美地满足这个条件。电能被转化为计算,计算产生的热量散逸到环境中——热力学第二定律告诉我们,这个过程在原理上不可逆。花掉的电不会因为任何人的意志而回到发电厂。这种不可逆性的根基不在协议代码里,而在宇宙的物理结构中。

第三,代价必须无需可信第三方来验证。

工作量证明(Proof of Work)在这一点上有一个优雅的数学性质:验证的成本极低,而生成的成本极高。任何节点都可以在毫秒级别内独立验证一个区块的工作量证明是否有效。不需要询问任何权威,不需要投票——验证是纯粹的本地数学运算。

三个条件:外部的、物理不可逆的、可独立验证的。目前已知唯一同时满足这三个条件的机制,是能量消耗——Proof of Work。这不是中本聪的主观选择,更不是一种可以被随意替换的”共识算法”。在已知的解空间中,PoW 是约束条件指向的唯一答案。

PoW——通过竞争实现诚实的排序

中本聪的方案可以用一句话概括:让矿工们通过消耗能量来竞争排序权,每一轮竞争产生一个区块。

每个矿工独立地收集未确认交易,组织成候选区块,然后反复尝试不同的 nonce 值,直到找到使区块头哈希满足难度目标的值。第一个找到的矿工赢得这一轮竞争,广播区块并获得区块奖励。

逐块竞争,没有积累优势。 每个区块的出块权都是独立竞争的。上一个区块的获胜者在下一轮没有任何优势。排序权在每一个区块的时间尺度上都在被重新争夺。

自利即诚实。 比特币不要求任何矿工是”好人”。在竞争机制下,诚实地按自己观察到的顺序打包交易,是最大化利润的策略。任何偏离诚实的行为都会增加孤块风险,降低期望收益。当自私的理性计算指向诚实行为时,系统的安全性就不再依赖于人性的善,而依赖于人性的自利——而后者是一个远比前者更可靠的假设。

这里有一个容易被忽视但极为重要的认知问题:矿工的”诚实”到底是什么意思?

在分布式网络中,“真相”本身就是一个问题。Alice 的交易和 Bob 的交易可能几乎同时被广播,由于网络延迟,矿工甲可能先收到 Alice 的,矿工乙可能先收到 Bob 的。在绝对意义上,哪笔交易”真的”先发生?这个问题没有答案。在一个没有全局时钟的分布式系统中,“绝对的先后顺序”是一个不存在的概念。

所以矿工面对的不是”真相”(Truth),而是”实相”——他们各自实际观察到的世界。在这个框架下,诚实不是”说出真相”,而是”如实报告自己看到的”。 矿工按照自己收到交易的先后顺序(first-seen 原则)来排列区块中的交易,就是诚实的。不诚实的定义是:明明先收到了交易 A,却在区块中把后收到的交易 B 排在前面——篡改了自己的实相。

当不同矿工的诚实实相互相冲突时,竞争机制发挥作用。多个矿工同时竞争,最终只有一个区块胜出——取决于谁先完成工作量证明。一旦某个区块被网络接受并被后续区块引用,它所包含的排序就成为事实上的全局共识。不是因为这个排序”更真实”,而是因为工作量证明提供了一个无需信任的选择机制。

值得指出的是,BTC(小区块版本的比特币实现)后来引入了 RBF(Replace-by-Fee,BIP 125),允许用户通过支付更高手续费来替换一笔已经被矿工收到但尚未确认的交易。这意味着矿工不再遵循 first-seen 原则,而是可以用”更高手续费”为由丢弃先收到的交易、接受后到的替代版本。RBF 从根本上破坏了”如实报告自己实相”的诚实机制——它使得矿工有正当理由篡改自己观察到的交易顺序。这不仅为双花攻击打开了窗口(攻击者可以先发送一笔低手续费交易,待对方确认收款后再用高手续费版本将其替换),也为 MEV 类型的交易排序操纵提供了协议层面的合法性。原始比特币协议中不存在 RBF——这是后来的偏离,而非原始设计。

比特币的核心工程成就在于:它没有试图在分布式网络中复原不存在的绝对真相,而是建立了一个机制,使得一组自利的、互不信任的参与者,在没有裁判的情况下,可以持续地就交易排序收敛到一致的结果。

小世界网络:经济激励驱动的网络拓扑优化

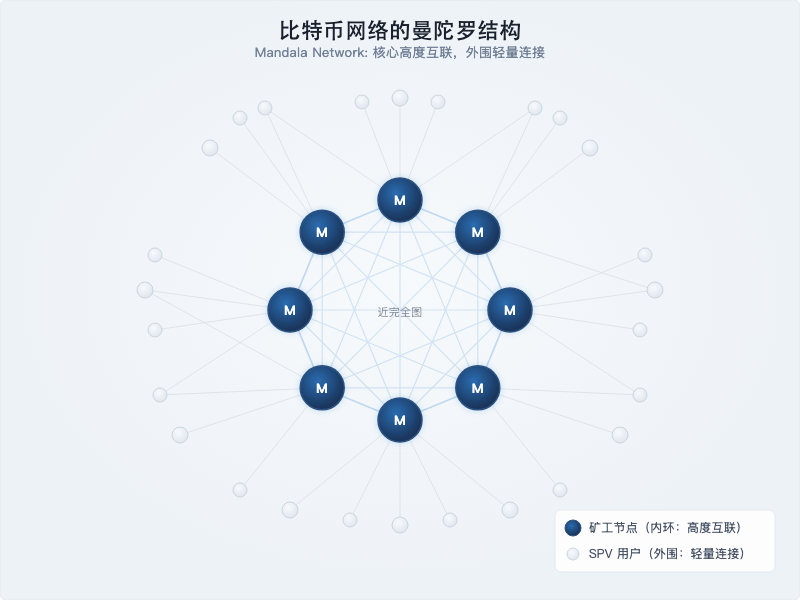

矿工之间存在持续优化网络延迟的经济动力。矿工如果接收新区块的速度比竞争对手慢,就更容易在已经过时的区块上浪费算力,面临更高的孤块风险。这个经济压力驱动矿工主动投资高带宽、低延迟的网络连接,使得主要矿工之间自然形成高度互联的网络拓扑——这正是 Watts 和 Strogatz 在1998年提出的”小世界网络”(Small World Network)结构:少数核心节点之间高度互联,平均路径极短。

这意味着比特币网络不需要任何协议层面的强制来优化连接质量——经济激励自动驱动网络拓扑趋向最优。而且区块越大,孤块风险的经济惩罚越重,优化网络连接的动力就越强。大区块不会拖垮网络——它会驱动网络变得更高效。

PoS 与 PoH:为什么它们不是区块链

前面的推导建立了一条清晰的逻辑链:双花问题→排序问题→排序权的争夺→作弊代价必须是外部的、物理的、不可逆的→Proof of Work。这条链上的每一环都不是可选项,而是约束条件的必然结果。

如果一个系统不满足这些条件,它可能是一个有用的分布式系统,但它缺少那个使区块链区别于一切先前技术的关键属性:不依赖任何可信参与者的排序保证。

Proof of Stake:旧瓶装旧酒

以太坊在 2022 年完成了从 PoW 到 PoS 的转型(The Merge)。

没有逐块竞争。 在 PoW 中,每个区块的出块权都是通过实时能量竞争决定的——在区块被挖出之前,没有人知道谁会赢。PoS 取消了这种竞争。系统提前指定每个时间段由哪个验证者出块,依据是质押数量的加权抽签。谁来打包下一个区块,在区块产生之前就已经确定了。其他验证者不是竞争者,而是投票确认者。如果把 PoW 比作公开拍卖——价高者得,PoS 就是预先分配的排班表——按质押比例轮流值班。这不是竞争,这是任命。

MEV:交易排序权的制度化商品化。 正因为出块者是预先确定的,一个完整的寻租产业链在以太坊上生长出来。专业搜索者扫描交易内存池寻找可提取价值——典型如三明治攻击;构建者将策略组合成利润最大化的区块;出块者只需选择出价最高的区块签名广播。约 90% 的以太坊区块通过这条路径产出。交易的排序权——区块链最核心的权力——被拆解成了一条标准化的产业链,每个环节明码标价。这不是系统被攻击了,这是系统按设计运行的结果。在 PoW 中,没有人能提前知道谁会挖出下一个区块,这条产业链从结构上就难以建立。

安全性的循环依赖。 PoS 的安全论证包含一个循环:账本的安全性依赖于代币的价值,而代币的价值依赖于账本的安全性。正常情况下这个循环是良性的,但在压力下会断裂——做空了代币的攻击者,其收益恰恰来自代币崩溃,“代币贬值会惩罚攻击者”这个威慑对他完全不起作用。PoW 不存在这种循环——矿工消耗的电力成本与比特币价格无关,攻击的代价锚定在物理世界,不锚定在被攻击系统自身的市值上。

“持续租赁”与”一次性夺城换锁”。 PoW 的攻击者面对持续出血:维持 51% 算力意味着每秒都在向电网支付巨额电费,经济可行性随时间急剧恶化。PoS 的攻击者一旦积累了 2/3 质押量,就获得了对共识的永久控制权——后续维持不需要额外支出。PoW 是向物理世界持续交租,PoS 是一次性夺城之后换掉了锁。

PoS 的支持者会指出还有最后一道防线:social slashing——当极端攻击发生时,社区可以在链下协调,通过硬分叉来没收攻击者的质押并恢复网络。但这个”防线”恰恰证明了问题所在:PoS 的最终安全保障不在协议内,而在协议外——依赖一群人在 Discord 或 Twitter 上讨论”哪条链才是正统的”,然后投票决定分叉方向。这是一个非正式的、主观的、不可预测的社会协调过程。换言之,PoS 在极端情况下的安全兜底机制,本质上就是一个可信第三方——只不过这个”第三方”不是一家公司,而是一个社区的社会共识。

审查风险。 PoS 验证者是已知的、持续在线的实体,天然成为外部压力的作用点。2022 年 OFAC 对 Tornado Cash 制裁后,高峰期超过 60% 的以太坊区块主动排除了受制裁地址的交易——不是被政府强制的,而是验证者主动选择审查。当验证者是已知实体时,他们就处于法律管辖之下。这是 PoS 架构的结构性结果。

本质:分布式数据库。 已知的参与者集合、预先指定的出块者、内部代币作为安全保证——这描述的正是 Byzantine Fault Tolerant 分布式数据库。PoS 用代币质押替换了传统 BFT 中的准入许可,但根本结构未变。给分布式数据库加上一个代币,不会把它变成区块链。

Solana 与 Proof of History

Solana 的 Proof of History 是一种通过连续 SHA-256 哈希链实现的可验证时钟机制。但 PoH 不是共识机制——Solana 的实际共识由 Tower BFT 完成,验证者集合已知,领导者按计划轮换,安全性依赖于 2/3 质押多数的诚实假设。Solana 多次全网宕机后的恢复流程——基金会在 Discord 上协调验证者同步重启——与公司运维团队凌晨重启数据库集群没有本质区别。而比特币自 2009 年上线至今,从未因需要中心化协调而停机。

PoS 的能耗恰好证明了问题

PoS 将能耗降低了约 99.95%——这个数字常被当作优点。但从本文的推导框架来看,它恰恰证明了问题:PoS 没有通过能量消耗来构建安全性。那 99.95% 不是”节省”下来的浪费,而是被移除的安全机制。

分布式系统分类

| PBFT等 | 以太坊PoS | Solana | 比特币PoW | |

|---|---|---|---|---|

| 参与者 | 已知 | 已知 | 已知 | 任何人 |

| 出块者 | 预定 | 预定 | 预定 | 竞争产生 |

| 外部能耗 | 无 | 无 | 无 | 大量 |

| 宕机恢复 | 人工协调 | 社会共识 | 基金会协调 | 自动调整 |

前三列之间的差异是程度上的。它们与第四列之间的差异是性质上的。PoS 和 PoH 不是区块链的替代方案,它们是分布式数据库技术的延续。

能量、熵与不可逆性——PoW 为什么”物理”

前面的论证反复触及一个词:不可逆。这些说法背后有一个更深的根基——热力学。

热力学第二定律:秩序必须被支付

热力学第二定律是物理学中最不可动摇的定律之一。其核心陈述:在一个孤立系统中,熵只会增加或保持不变,永远不会自发减少。 推论是:要在局部创造秩序,你必须从外部输入能量,并且这个过程必然在别处产生更多的无序。 秩序不是免费的,它的账单由能量来支付。

比特币账本是熵减

比特币的账本是一个高度有序的结构:数十万个区块,每个区块内的交易经过验证、排序、打上时间戳,区块之间通过哈希指针形成严格的单向链条。这种程度的有序性不可能自发出现。

比特币账本的创建过程,本质上是一个持续的熵减过程:从无序(未确认交易随机传播)到有序(每笔交易被精确安置在唯一位置上)。根据热力学第二定律,这种熵减不可能凭空发生,必须有外部能量输入。那个承担熵增的地方就是矿机的散热器和电厂的燃烧室。

PoW 的能耗不是浪费,是物理学的必然要求

“PoW 浪费能源”这个批评需要被重新审视——不是在”值不值得”的层面,而是在”能不能”的层面。热力学告诉我们,创造和维护这种程度的秩序,能量消耗有一个不可压缩的下限。你不可能不付出能量代价就在数字世界中制造物理性。

更关键的是,PoW 的能耗同时也是”保卫秩序”的壁垒。每一个被挖出的区块,其背后的能量消耗都是热力学不可逆的。要改写比特币的历史,攻击者必须重新花费至少同等量级的能源。

PoW 的博弈有物理学兜底,PoS 只有博弈论自己兜底

PoW 的安全性当然包含博弈论成分。但这个博弈论有一个物理学决定的硬底线:发动攻击所需的能源成本由电价、芯片制造成本和热力学效率共同决定,这些变量完全在比特币系统之外。即使你是一个纯粹的破坏者,你仍然需要向物理世界支付真实的能源账单。

PoS 的安全性也建立在博弈论之上。但这个博弈论没有物理学下限。当攻击者不在乎代币价值、通过做空对冲了损失、或代币价格已因外部原因暴跌——没有任何物理层面的安全保障在下面接住。博弈论的屏障破了就是破了,底下是空的。

Hugo Nguyen 对此有一个精辟的概括:

“PoW is essentially a mechanism to stamp physical reality onto a digital artifact.” (PoW 本质上是将物理现实印刻到数字制品上的机制。)

PoW 不只是一种”共识算法”,它是数字世界与物理世界之间的桥梁。通过能量消耗这个中介,比特币账本获得了一种数字信息本不该拥有的属性——物理性。

问题不是”花这么多电值不值”——真正的问题是:你能不能不花这个代价就得到同样的东西? 热力学的回答是不能。这不是工程问题,是物理定律。

不可篡改的公共账本——数字世界的白纸

回顾全部推导。从信息的可复制性出发→双花问题→排序的必要性→代价必须是外部的、物理的、不可逆的→热力学确认代价不可绕过。这条逻辑链的终点,是一个具备了物理属性的数字制品——比特币的账本。

这个账本同时拥有三个在此之前数字世界从未拥有的属性:

- 制造有成本。 每一个区块都凝结了真实的能量消耗,热力学保证这个成本不可逆、不可伪造。

- 写入后不可更改。 累积的算力为历史记录构建了一道随时间持续增厚的物理屏障。

- 不可损毁,永久存在。 账本的完整副本分布式存储在全球数以万计的独立节点上。

这三个属性合在一起,描述的不是某种抽象的数据库特征。它们描述的是纸。

物理世界的纸张天然具备这些性质:制造需要消耗资源,写上的墨迹难以无痕消除,纸张本身可以长期保存。正是这些性质使得纸成为人类文明最基础的记录载体——契约写在纸上,法律刻在石碑上,产权登记在册页中。

而在比特币之前,数字世界从不存在这样的东西。比特是无重量的、可复制的、可无痕修改的——它是一种完美的通信介质,却是一种糟糕的记录介质。所有数字世界中的”记录”,其可信度都不得不依赖于某个机构的信誉。

比特币改变了这一点。PoW 通过将物理世界的能量不可逆地灌注到数字结构中,第一次在比特的世界里制造出了”白纸”——一种具有物理性的数字载体。

这张白纸已经存在。下一个问题是:你能在上面写什么?

重新定义去中心化:不可能三角的谬误

但在回答这个问题之前,需要先破除一个行业最深层的误解。

2017 年,Vitalik Buterin 提出了区块链的”不可能三角”:去中心化、安全性、可扩展性三者不可兼得。这个见解迅速成为行业的共识。问题在于:不可能三角不是物理定律,甚至不是严格的数学证明。它是一个建立在特定定义之上的推断——而那个定义是错的。

节点数量不等于去中心化

不可能三角的核心逻辑:要保持去中心化,就需要大量节点独立验证每一笔交易;如果每个节点都必须处理所有交易,吞吐量就受限于单个节点的处理能力。

这条推理链的第一个前提就有问题:它将去中心化等同于”大量节点独立验证所有交易”。

垄断的错误定义——奥地利学派的启示

主流经济学用市场集中度来定义垄断:有多少家企业在竞争?市场份额如何分布?

奥地利学派经济学家对此提出了根本性的反对。

Rothbard 在 Man, Economy, and State 中论证:在自由市场中,真正有害的垄断只有一种形式——政府授予的排他性特权。如果没有法律壁垒,即使市场上只剩一家企业,那也不是有害的垄断。关键问题不是”有多少竞争者”,而是”是否有人被阻止参与竞争”。

“It is not the number of competitors but the freedom of entry that is crucial.” (关键不在于竞争者的数量,而在于进入的自由。)

Hayek 在 Competition as a Discovery Procedure(1968)中将竞争定义为一个动态过程,而非一个静态状态。一个市场在任一时刻只有一家企业并不意味着缺乏竞争——如果任何人都可以自由进入。一个市场有一百家企业但全部受牌照壁垒保护,真实的竞争可能为零。

Mises 在 Human Action(1949)中同样指出,判断市场是否具有竞争性,关键在于市场是否对新进入者在法律上开放。

综合三位经济学家的洞见:用”有多少竞争者”来衡量竞争程度是错误的,正确的标准是”是否任何人都可以自由加入竞争”。

映射回区块链:不可能三角用节点数量来衡量去中心化,恰如主流经济学用企业数量来衡量竞争——犯的是完全相同的错误。正确的问题是“是否任何人都可以自由加入挖矿竞争,无需许可,无需任何在位者的批准”。

PoW vs PoS:流量资源与存量资源

PoW 是流量资源(flow resource)。 能源必须被持续获取和消耗。昨天消耗的电力对今天的竞争力贡献为零。所有参与者——包括最大的在位者——必须每天重新支付入场费。更便宜的能源、更高效的芯片,随时可以让新进入者颠覆最大的在位矿工。

PoS 是存量资源(stock resource)。 代币质押后不消耗、不折旧。一个拥有全网 10% 质押量的验证者,即使什么都不做,明天仍持有 10% 的份额。质押收益按比例分配给已有质押者,份额自动维持甚至增长。早期进入者的地位是自我维持的。

Hayek 所说的”动态竞争”要求参与者的地位不断被市场过程重新检验。PoW 强制实施了这种动态竞争:每一个区块都是一场新的竞赛。而 PoS 允许静态的在位优势——一旦积累了足够质押量,地位就被协议设计本身制度性地保护了。

用奥地利学派的框架来看:PoS 中的大质押者类似于受牌照保护的在位企业——新进入者必须先从在位者手中购买代币。而 PoW 中的在位矿工更像开放市场中的企业——明天如果有人找到了更便宜的电或更高效的芯片,你的优势就可能被瓦解。

结论:不可能三角建立在一个错误的定义上。如果用正确的定义——动态的自由进入与持续竞争——去中心化与可扩展性之间根本不存在矛盾。

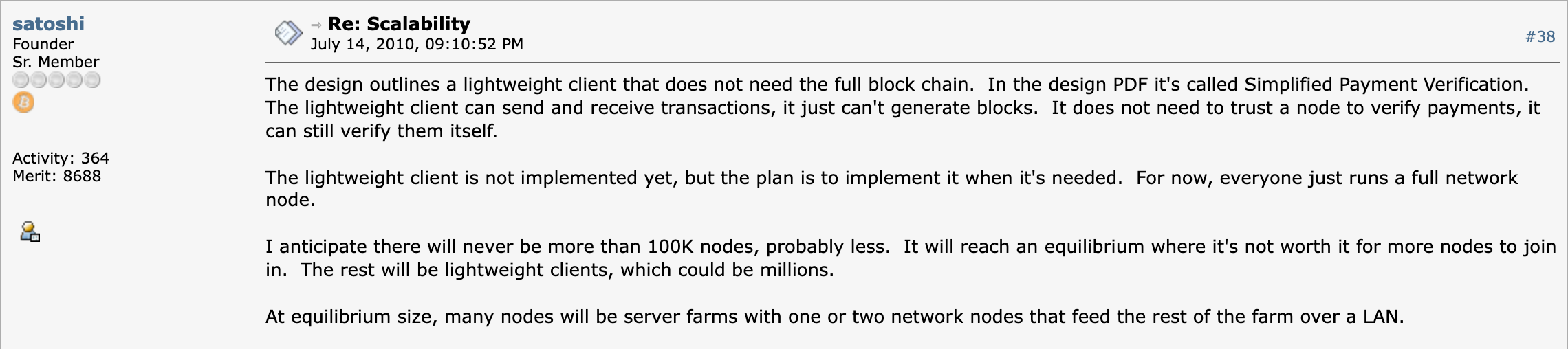

SPV:中本聪的原始扩容设计

不可能三角的另一个隐含假设是:每个用户都需要运行一个验证全部交易的全节点。这个假设直接违背比特币的原始设计。

白皮书第 8 节描述了 Simplified Payment Verification(SPV):普通用户只需保存区块头——每个 80 字节,一年约 4.2 MB——通过 Merkle 证明验证特定交易是否被包含在某个区块中。这不是后来的补丁方案,这是中本聪从一开始就内置的扩容架构。

Merkle 树的威力在于其指数级的扩展能力。树每增加一层,可容纳的交易数量翻倍,但证明一笔交易存在于区块中所需的数据只增加一个哈希值(32字节)。具体来说:一个包含4,096笔交易的区块,证明路径只需要12个哈希;包含100万笔交易的区块,证明路径只需要20个哈希(640字节);包含10亿笔交易的区块,证明路径也只需要30个哈希(960字节)。而区块头始终是固定的80字节,不随区块大小变化。

这个设计选择本身就是中本聪意图的有力证据。如果比特币只是为了每秒处理7笔交易而设计——一个区块最多4,200笔交易——一个简单的交易列表就完全够用,根本不需要 Merkle 树这样的数据结构。只有当你预期区块将包含数百万甚至数十亿笔交易时,Merkle 树的对数级证明路径才是必要的工程选择。中本聪在2008年就设计了这个结构——这不是事后的优化,而是从一开始就为大规模扩容做的架构准备。

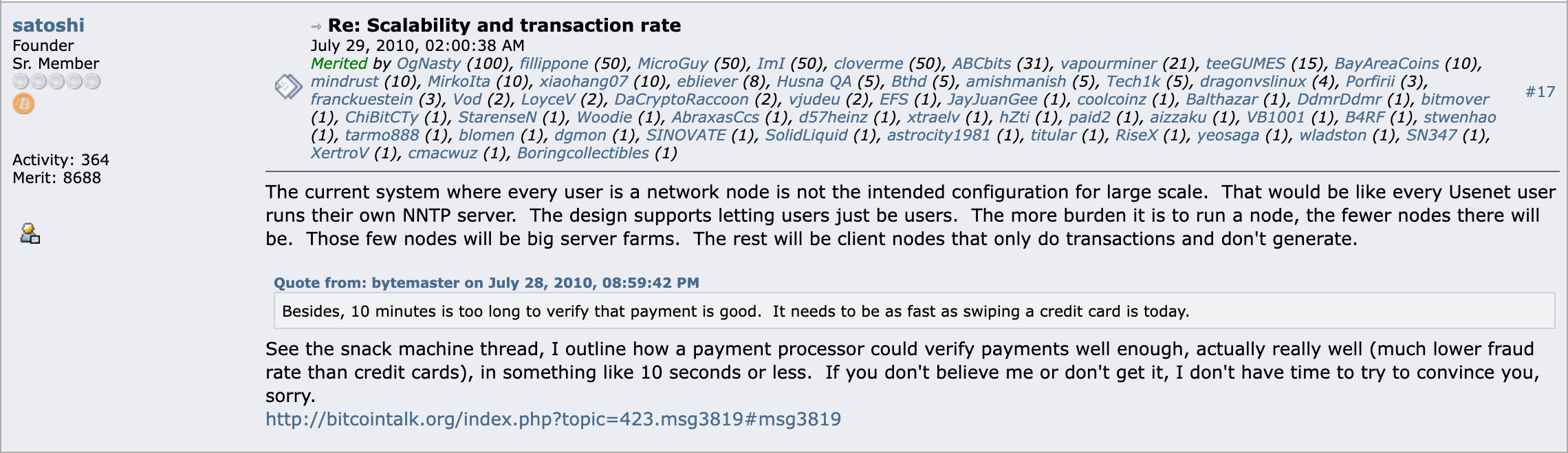

中本聪在 BitcoinTalk 上的发言进一步明确了设计意图:

比特币网络在成熟形态下,应由少数大型专业节点处理交易和构建区块,普通用户通过 SPV 进行支付验证。白皮书第 5 节定义的节点操作步骤每一步都涉及区块构建或 PoW 执行——在白皮书的定义中,节点就是矿工。不参与出块的机器不是节点。

需要说明的是,本文对”节点”的定义遵循白皮书第5节的原始表述,而非后来BTC社区扩展后的用法。在白皮书的定义中,节点是参与出块和PoW竞争的实体。一台下载了完整区块链但不参与出块的机器,在这个定义下不是节点,对共识的贡献是零。这就像站在山顶上观看机场的飞机起降:你能看到所有航班,但你无法影响塔台的任何一个调度决定。看到和影响是两回事。

“每个人都应该运行全节点”这个叙事的逻辑困境:如果全节点不出块,它就不参与共识,那么它的数量多少对网络的去中心化没有影响。你为了维护一个对共识没有贡献的指标,牺牲了系统的实际能力。

互联网提供了直接的类比。绝大多数用户不运行 Web 服务器。互联网的开放性不在于每个用户都运行服务器,而在于任何人都可以架设服务器、任何人都可以接入网络。比特币的去中心化遵循完全相同的逻辑。

大区块与小区块的根本分歧:比特币是什么?

去中心化与可扩展性之间不存在矛盾,那么围绕区块大小的十年争论到底在争什么?

小区块派:比特币是”数字黄金”。区块要小,节点运行门槛要低,价值在于稀缺的价值储存工具。

大区块派:比特币的账本是通用的”数字白纸”。PoW 第一次在比特的世界中制造出了具有物理性的记录载体。人为限制它只能记录比特币转账,就是对其本质的阉割——这就好比发明了纸张,然后立法规定纸张只能用来写借条。

但小区块派的叙事包含一个更深层的经济学主张:比特币应先成为”数字黄金”(价值储存),再考虑其他用途。这个主张搞反了货币演化的因果链。

货币理论:从商品到货币的正确路径

Carl Menger 在 1892 年的 On the Origins of Money 中提出:货币不是由法律创造的,不是国家的发明。它在起源上是一种自发的社会制度。

“Money has not been generated by law. In its origin it is a social, and not a state institution.” (货币不是由法律产生的。它在起源上是一种社会制度,而非国家制度。)

在以物易物的经济中,最可售的商品逐渐被所有人接受为交换媒介——货币就此诞生。Mises 在 1912 年的”回归定理”进一步追问:货币的购买力必须追溯到它作为普通商品被估价的那个历史时刻。Rothbard 把这个逻辑推到了极致:

“Money cannot originate in any other way, neither by everyone suddenly deciding to create money out of useless material, nor by government calling bits of paper ‘money.’” (货币不可能以其他任何方式产生——既不是所有人突然决定用无用的材料创造货币,也不是政府把几张纸叫做”货币”就能成立的。)

综合三位经济学家的洞见,货币的演化遵循一条严格的路径:

- 使用价值。 一种商品首先因为非货币用途被估价。

- 可售性。 其物理属性使它比其他商品更容易在交换中被接受。

- 交易媒介。 越来越多的人用它作为间接交换的中介。

- 记账单位。 人们自然开始用它来标价。

- 价值储存。 被广泛接受后,人们自然愿意持有它。

Rothbard 对此的关键论述:

“Many textbooks say that money has several functions: a medium of exchange, unit of account, or ‘measure of values,’ a ‘store of value,’ etc. But it should be clear that all of these functions are simply corollaries of the one great function: the medium of exchange.” (许多教科书说货币有若干功能:交换媒介、记账单位或”价值尺度”、“价值储存”等。但应当明确的是,所有这些功能都不过是那个唯一核心功能——交换媒介——的推论。)

价值储存是成为货币的结果,不是成为货币的前提。 因果链是单向的,不可倒转。

公平地说,小区块派最强版本的论述是:比特币已经具备优良的货币属性——绝对稀缺、可分割、抗审查——市场会自然地首先将其作为价值储存工具接受。这个论述值得认真对待,但它有一个致命弱点:如果你人为限制了区块大小,使得链上交易费用高昂、速度缓慢,你恰恰在削弱”抗审查价值转移”这个你声称的使用价值。 一个每秒只能处理 7 笔交易、手续费动辄数十美元的网络,对绝大多数人来说根本不是可用的价值转移工具。

黄金的启示:从货币到投机标的的退化

黄金的历史完美地验证了上述理论。黄金的使用价值可追溯到公元前 4000 年——最早用于首饰和装饰。随后其物理属性使它具有最高的可售性,约公元前 700 年正式成为交易媒介,此后数千年演化为全球通用货币。

然后方向逆转了。1933 年罗斯福禁止公民持有黄金,1971 年尼克松终止美元与黄金的可兑换性。今天的黄金不再是交易媒介,不再是记账单位,其主要角色是投资标的和投机工具。这是货币演化路径的反向运动。

如果比特币走”数字黄金”路线,它对标的不是黄金的辉煌岁月,而是黄金的当下状态:一种纯粹的投机标的。

当然,即便沦为投机标的,BTC(小区块版本的比特币实现)的市场价格依然很高。这主要有两个原因:第一,一部分人对区块链技术的认知和对未来大规模应用的期待,产生了囤积需求——这就是所谓的”比特币信仰者”;第二,比特币作为纯粹的投机或赌博标的,确实非常优秀——24小时交易、全球流通、高度波动、无涨跌停限制——甚至比黄金还要优秀得多。赌博和投机是一个巨大且永恒的市场需求,这毋庸置疑。但这两个原因都不能使比特币成为货币。

比特币的商品使用价值:邮票与邮递服务

比特币的唯一功能是向矿工支付手续费,以换取在账本上记录信息的权利。 比特币是购买账本记录服务的对价。

用邮票来类比最为直观。邮票的使用价值不在于那张小纸片本身,而在于它所购买的服务——邮递。如果邮政系统停摆,邮票立刻变成废纸。同理,比特币的价值取决于账本记录服务的价值。

这个类比揭示了一个关键前提:账本记录服务必须有多样和广泛的用途,比特币才具有真实的商品使用价值。

如果账本只能记录比特币自身的转移,那么比特币的使用价值就陷入了自指循环:用比特币来转比特币。这就好比一个邮政系统只允许你寄邮票。如果账本可以记录任何信息——合同存证、供应链追踪、身份验证、知识产权登记、金融结算——那么比特币的使用价值就锚定在真实的外部需求上。这才是 Menger 所说的”非货币用途”,才是 Mises 回归定理所要求的那个起点。

因果链的汇合

Menger、Mises 和 Rothbard 的货币理论告诉我们:货币必须从有使用价值的商品演化而来,先成为交易媒介,再成为价值储存。价值储存是结果,不是前提。

小区块派限制区块大小的后果是三重的:

第一,它摧毁了账本的通用性。 一张只能写借条的白纸,不再是白纸。

第二,它摧毁了比特币的商品使用价值。 当账本只能记录比特币自身的转移时,使用价值变成了自指的。没有外部需求锚定其价值,Mises 回归定理所要求的非货币用途起点就不存在。

第三,它摧毁了比特币成为货币的可能性。 没有真实的商品使用价值,就无法启动 Menger 描述的从商品到货币的演化路径。比特币被迫走上”数字黄金”轨道——而这条轨道对标的是黄金退化为投机标的的下降路径。

这就是大区块与小区块之争的本质。不是关于技术参数的工程争论,而是关于比特币能否成为货币的存亡问题。

比特币脚本:一种被误解的图灵完备系统

如果账本的价值取决于它能承载多少种用途,那么账本到底能做什么?“比特币只能转账”是行业中最根深蒂固的刻板印象之一。

Forth:被航天器验证过的语言范式

比特币脚本是一种基于堆栈的编程语言,其设计直接继承了 Forth 语言的范式。Forth 由 Chuck Moore 于 1968 年发明,极简、组合能力极强,一个完整的 Forth 系统可以在 8KB 内存中运行。

极小的体积带来极高的可验证性。Forth 被部署在对可靠性要求最极端的场景中——NASA 多个航天器的控制系统使用 Forth,在距离地球数亿公里的地方,软件故障意味着任务永久失败。中本聪选择 Forth 式语言,是因为保护数十亿美元资产的系统,其脚本语言必须简单到可以被完全理解和审计。

没有循环不是缺陷,是安全特性

比特币脚本不支持循环。批评者认为这使它”功能不全”——这完全搞反了因果关系。

如果脚本语言允许循环,恶意用户可以构造永不终止的脚本,每个验证节点执行时都会陷入无限循环,全网瘫痪——对于任何图灵完备的语言,都无法在执行前判定任意一段代码是否会终止,这就是著名的图灵停机问题(Halting Problem)。比特币去掉循环,脚本长度本身就是执行时间的硬上限。停机问题在语言层面被消除了。

以太坊选择了另一条路:允许图灵完备的语言,用 Gas 机制限制执行时间。Gas 本身成了一个复杂的新子系统:价格需要估算、市场可以被操纵、Out-of-Gas 导致交易回滚但手续费照扣。比特币用一条简洁的语言约束解决的问题,以太坊用一套持续演化的经济机制来应对。

系统级图灵完备:交易链即计算

单个比特币脚本是图灵不完备的。但比特币的交易模型允许更深层的计算范式:每笔交易消费一组 UTXO,执行脚本验证,产生新的 UTXO 携带新状态。每笔交易是一个计算步骤,交易链是一个计算序列。 单个步骤保证终止,但步骤序列可以无限延伸——从而实现任意复杂度的计算。

整个比特币系统——脚本语言加上交易链——构成了一个图灵完备的计算平台。安全性和计算完备性在不同层面上被分别保证。

sCrypt 和 Runar 等项目已在实践中证明:开发者可以使用高级语言编写基于 UTXO 模型的智能合约,已实现状态化智能合约、代币协议、零知识证明验证等功能。比特币不需要一个单独的”智能合约平台”——它本身就是一个。

UTXO vs 账户模型:扩容的结构性优势

脚本语言决定了账本”能做什么”,数据模型决定了”能做多快”。

UTXO:天然可并行的数据结构

理解 UTXO 最直观的方式是把每一个 UTXO 想象成一枚硬币(事实上,比特币的源代码中就用 Coin 来命名 UTXO)。全世界的人可以同时使用无数枚硬币进行交易,互不干扰——你在北京用一枚硬币买咖啡,不会阻塞纽约另一个人用另一枚硬币买面包。UTXO 模型的并行性与此完全一致。

UTXO 的核心思想:没有”账户”,没有”余额”。每笔交易消费已有 UTXO 作为输入,产生新 UTXO 作为输出。每个 UTXO 是独立的、自包含的状态单元,不引用任何全局状态。消费不同 UTXO 的两笔交易之间数据依赖为零,可以同时处理。冲突检测只需检查两笔交易是否试图消费同一个 UTXO——这是最理想的并行化场景:零共享状态,零通信开销。

账户模型:天然串行的瓶颈

以太坊的账户模型中,对同一账户的多笔交易必须严格串行处理——每笔都需读取、修改、写回余额,否则就是竞态条件。nonce 的严格递增进一步强化了串行性。智能合约使问题更严重:一个 DeFi 合约可能同时访问多个合约的状态,产生复杂的依赖关系。以太坊的 EVM 按严格顺序逐笔执行交易——这是账户模型的结构性必然。

以太坊放弃执行分片转向 Rollup 路线,印证了这一点:账户模型下跨分片交易极难处理,DeFi 的同步可组合性在分片环境下将无法实现。UTXO 模型不存在这个问题——UTXO 是自包含的状态单元,将 UTXO 集合分布到多个分片上,只需保证同一个 UTXO 不被两个分片同时处理即可。

中本聪选择 UTXO 模型不是偶然的。扩容的瓶颈不在数据结构上,而在带宽和存储上——而后两者随硬件技术进步持续改善。账户模型则把瓶颈焊死在数据结构本身——全局共享状态的串行访问是一道无法通过加处理器核心突破的硬墙。

公共账本 = 全球公共基础设施

至此,我们从第一性原理推导出了账本的全部关键属性:PoW 赋予它物理性和不可篡改性,UTXO 赋予它天然的并行扩容能力,脚本系统赋予它图灵完备性。合在一起,我们得到的是一张任何人都可以读写、不可篡改、无需许可、能够承载任意数据和逻辑的全球公共账本。

这张白纸天然是全球公共基础设施,正如互联网是全球公共信息基础设施一样。互联网统一了信息的传输,比特币的公共账本统一了价值的记录。一个是信息的公共基础设施,一个是确权与结算的公共基础设施。

跨链与 L2:重新引入可信第三方

当一条链的容量不足时,行业的主流回应不是扩大链本身,而是在它旁边搭建辅助结构。这些方案共享一个结构性特征:为了扩容,重新引入了区块链最初要消除的东西——可信第三方。

跨链桥需要中继者或多签委员会来验证跨链消息。2022 年仅 Ronin(6.25 亿美元)、Wormhole(3.26 亿美元)、Nomad(1.9 亿美元)三起事件的损失总额就超过 11 亿美元。跨链桥的安全模型本身就建立在”信任一小撮中间人”之上。

L2/Rollup 的排序器是单一实体运行的中心化服务——Arbitrum 的排序器由 Offchain Labs 运营,Optimism 的由 OP Labs 运营。乐观 Rollup 的本质是”先信任一个中间人,如果他作弊再上诉”——这与”先信任银行,银行偷钱再去法院告”是同一个信任模型。

闪电网络的存在不是因为比特币协议有内在的容量天花板——它是因为人为的 1MB 区块大小限制使主链无法承载足够的交易量。

这些方案的共同本质:把交易从一个不需要信任任何人的环境(L1 主链),移到了一个需要信任某些人的环境。 这是方向性的倒退。

比特币和以太坊走向 L2 的根因完全不同。比特币是因为人为的小区块限制——UTXO 模型天然支持并行,瓶颈是人为制造的。以太坊是因为账户模型的串行瓶颈——即使区块大小放大百倍,交易仍然只能逐笔执行。根因截然不同,但殊途同归——都重新引入了可信第三方。

四个角度反驳”L2 是应用层”

L2 支持者常用互联网做类比:“一个结算层 + 多个 L2 执行层”是合理的分层架构。这个类比从四个角度来看都是错的。

第一,区块链不是传输层。 TCP/IP 只搬运数据包,区块链排序、验证、永久记录。区块链对应的不是 TCP/IP,而是整个互联网。L2 对应的不是”互联网上的应用”,而是互不兼容的封闭局域网。

第二,L2 打破了端到端信任。 用户的交易离开 L1 进入 L2 后,由单一排序器处理。乐观 Rollup 还有 7 天挑战期——本质是”信任 + 追诉权”,与传统金融的”信任银行 + 法律追索”结构同构。

第三,L2 是 L1 缺陷的产物。 如果 L1 本身能够扩容,L2 完全没有存在的必要。就像互联网骨干网从 56kbps 升级到光纤,每一次升级都消灭了一批曾经”不得不存在”的专有网络方案。

第四,精确的对应关系。

| 互联网 | 区块链 |

|---|---|

| TCP/IP 统一网络 | 一条链统一账本 |

| 网络上的多样化应用(Web、Email、视频) | 链上的多样化应用(支付、合约、代币化资产) |

| 升级骨干网带宽(56kbps → 光纤) | 链上扩容(大区块 + UTXO 并行) |

| 骨干网太慢 → 建专有局域网 | L1 太慢 → 建 L2 |

| CompuServe、AOL 等封闭网络 | 各个 L2(Arbitrum、Optimism、zkSync) |

| 封闭网络间的邮件网关 | L2 之间的跨链桥 |

以太坊的 L2 生态不是”互联网统一之后的应用层多样化”,而是“互联网统一之前的封闭网络时代”。

最终只有一条链

逻辑结论只有一个:所有交易最终一定会汇聚到同一条链上——因为这是效率最高、成本最低、摩擦最小的方案,经济规律会驱动这个结果的发生。

信任模型上的口子不是程度问题——要么你不需要信任任何第三方,要么你需要。没有中间态。

经济逻辑也指向同一个结论。Metcalfe 定律:网络的价值与用户数量的平方成正比。一个拥有一百万用户的统一网络,其价值是十个各有十万用户的分裂网络价值之和的十倍。网络效应奖励统一,惩罚碎片化。

链不是工具,链是网络。工具的价值在于功能,网络的价值在于连接。一把锤子和一把螺丝刀各有用途,合并没有意义。但一个只能打给北京用户的电话和一个只能打给上海用户的电话,合并成全国网络后价值会发生质变。区块链是后者。

互联网的历史验证

1980 年代的计算机网络世界与今天的区块链世界惊人地相似。那时不存在”互联网”这个统一的东西,存在的是一堆互不兼容的封闭网络——CompuServe、AOL、Prodigy、BITNET、FidoNet——每一个都有不同的地址格式、通信协议、客户端软件。跨网络通信需要通过邮件网关——不可靠、速度慢、经常丢失消息。这就是1980年代的”跨链桥”。

反对网络统一的声音,与今天反对单链的论据一一对应:

- “不同网络服务不同目的” → “不同链服务不同场景。”

- “单一网络无法处理所有流量” → “一条链无法处理所有交易。”

- “专用网络效率更高” → “Solana 比以太坊快得多。”

- “安全需要隔离” → “跨链桥是安全风险,所以各链应该保持独立。”

每一条在当时都有合理性。每一条在事后都被证明是错的。TCP/IP 在几乎每一个单项技术指标上都不是最好的——但统一网络的经济效益远超碎片化网络之和。Metcalfe 定律不关心你的协议栈有多优雅——它只关心有多少人在同一个网络里。

时间线值得注意:ARPANET 1969 年上线,1983 年 TCP/IP 成为标准协议,1991 年互联网开始商业化——从 ARPANET 到商业化花了约 22 年。但临界点一旦到达,收敛速度令人震惊:1991 年多数流量仍在封闭网络中,到 1995 年互联网流量已压倒性超过所有封闭网络总和。从碎片化到统一,只用了约四年。封闭网络从主导地位到无关紧要,不到十年。

它们不是被某个竞争对手打败的。它们是被一个开放的、统一的、无需许可的公共网络吞噬的。

比特币诞生于 2009 年。我们现在是 2026 年。

链上扩容:唯一符合第一性原理的路径

前文的推演已逐一封死了其他出路。跨链桥重新引入可信第三方,L2 将交易推到链下,分片破坏了单一账本的统一性。排除法做完,剩下的选项只有一个:在同一条链上直接扩容。

而 UTXO 模型的天然并行性,使这条路径在数据结构层面就是可行的。

扩容是工程问题,不是政治问题

区块大小本应是一个根据技术条件动态调整的工程参数,正如互联网带宽从 56kbps 升级到光纤,每一次跃迁都是工程师评估硬件能力和用户需求后做出的技术决策。但区块链行业把区块大小异化成了政治立场和部落图腾。一个本可以随硬件能力平滑升级的参数,被冻结在 2010 年的水平长达十余年。

从第一性原理出发,“要不要扩容”从来不是问题。剩下的唯一问题是“怎么扩”——一个纯粹的工程问题。

从单体架构到微服务

传统比特币节点是单一进程,独自承担所有功能——经典的单体架构,扩容只能靠垂直扩展,有硬性天花板。

正确的问题是:每个任务需要多少台机器,如何协调它们? 解法来自互联网基础设施的核心经验——将单体系统拆分为独立的微服务,每个微服务根据自身瓶颈独立扩展:交易验证(CPU 密集型,增加无状态验证器实例)、UTXO 存储(I/O 密集型,分布式分片存储)、网络传播(多实例并行连接)、区块组装(增量式 Merkle 树构建)、内存池(分布式存储)。各服务通过异步消息队列通信,松耦合,某个环节成为瓶颈时只需增加该环节的实例数。

大区块传播也不是问题——绝大部分交易在被打包前就已通过网络传播到各节点的内存池中,区块传播只需发送区块头和交易 ID 列表。一个数 GB 的区块,实际传播开销可能只有几 MB。

已被工程验证的事实

BSV(Bitcoin Satoshi Vision)的 Teranode 节点实现,已经在全球分布式测试网络中持续两周验证了百万级 TPS 的链上处理能力,区块大小达到 GB 级别。 2024年7月,Teranode在与数据库厂商Aerospike的联合测试中达到了数据库层300万TPS(对应约100万全局比特币交易/秒)。2025年10月,BSV协会公开发布了Teranode源代码(GitHub: bsv-blockchain/teranode),两个矿工已在BSV主网上使用Teranode成功出块。Teranode正是采用了上述微服务架构——将交易验证、UTXO存储、网络传播、区块组装拆分为独立服务,利用UTXO模型的天然并行性实现水平扩展。

作为参照:BTC节点约7 TPS。Visa全球网络的最新官方峰值容量约为每秒83,000条交易消息,日均实际处理的支付交易约1,700 TPS。百万级TPS意味着单条链的链上吞吐量已经超越全球所有传统支付网络的处理能力总和——不是通过L2,不是通过分片,而是在同一条链上、同一个共识机制下、同一份不可篡改的账本中。

扩容从来不是技术上做不到。阻止扩容发生的从来不是技术瓶颈,而是行业的政治分歧。

这里有一个值得深思的现象:我们总是听到”比特币信仰”这个词——对去中心化的信仰,对数字黄金的信仰。但”信仰”这个词本身就说明了问题。我们之所以用”信仰”这种虚无缥缈的词汇,恰恰是因为它还没有被真正实现。没有人说”我信仰互联网”,没有人说”TCP/IP 是我的信仰”。互联网不需要任何人的信仰——它就在那里,你打开浏览器就能用。

比特币应该走同样的路。去中心化不是一种需要被信仰的理念,而是一个已经被工程实现的技术属性。扩容不是一个需要站队的政治立场,而是一个已经被验证的工程方案。当比特币真正完成了它的工程使命——一条可以无限扩容的、承载全球交易的公共账本——“比特币信仰”这个词将自然消亡。就像”互联网信仰”从未存在过一样,因为没有人需要信仰一个你每天都在使用的基础设施。

终局:全球统一账本

当一条可以无限扩容的链存在时,所有资金和资产最终都将通过代币化的形式在这条链上统一。

这不是预测,不是愿景,不是信仰。这是本文全部推演的逻辑终点。回顾完整的推演链:

- 物质不可复制,信息天然可复制——数字世界缺乏物理性。

- PoW 通过能量消耗在数字世界制造了物理性——不可篡改的公共账本由此诞生。

- 这个账本是全球公共基础设施——任何需要确权和不可篡改记录的信息都应写入其中。

- 所有交易最终汇聚到同一条链上——跨链和分层都违背第一性原理,网络效应奖励统一、惩罚碎片化。

- 这条链必须能够无限扩容——而这已被工程验证为可行。

- 因此,所有需要确权、记录和转移的价值,最终都会以代币化形式存在于这条链上。

每一步都是前一步的逻辑必然。没有跳跃,没有信仰飞跃,没有”如果我们相信”。从物质与信息的本质差异出发,经过严格的逐步推演,终点只有一个。

这就是区块链的第一性原理所指向的终局。不是”要不要”的问题——推演已经回答了这个问题。剩下的只是”怎么做”和”多快到达”。而答案,已经在工程中被证明是存在的。

比特币已经诞生将近二十年。在这二十年里,它从一个密码学实验变成了一个万亿美元级别的投机市场,催生了无数的链、无数的代币、无数的叙事。但如果我们诚实地审视这个行业的现状:绝大多数从业者谈论的依然是信仰、政治主张和部落纷争,而不是技术本质和工程实现。

是时候回到原点了。比特币的白皮书标题是”一种点对点的电子现金系统”——不是数字黄金系统,不是投机工具,不是政治宣言。它的设计目标从第一天起就是明确的:一个全球统一的、无需信任的价值互联网。

当然,构建这样一个全球统一的价值互联网,其变革之深远、系统之复杂,远超我们今天的想象。十多年来,无数从业者的各种努力和尝试——PoS、多链生态、L2、跨链协议——有些可能是弯路,有些甚至是倒车,但从更大的尺度来看,这些都是一个庞大系统在探索过程中不可避免的试错。一个将要重塑全球价值流转方式的基础设施,不可能在第一次尝试中就找到正确的路径。

而且,这从来不仅仅是一个技术问题。比特币天然的金融属性使其成为巨大利益纷争的焦点,甚至成为大国博弈的工具。区块链行业长期被污名化,“傻逼的共识也是共识”竟然成了行业内部的自嘲共识,创业者不得不在全球流窜进行监管套利。这些乱象是真实的,但它们是任何颠覆性技术在早期都会经历的混沌——互联网早期同样充斥着诈骗、泡沫和监管真空。

但无论政治如何博弈、利益如何纠缠、叙事如何变迁,回归第一性原理,构建一个全球统一的价值互联网,归根结底是一个技术问题。政治的影响以年为单位,经济周期的影响以十年为单位,而技术的影响以百年为单位。短期的混乱不会改变长期的方向。

实现这个目标不需要信仰,只需要工程。

停止 HODL,开始 BUIDL。